省吃俭用

美帝封锁了GPU,在有限的人子里,买买买,

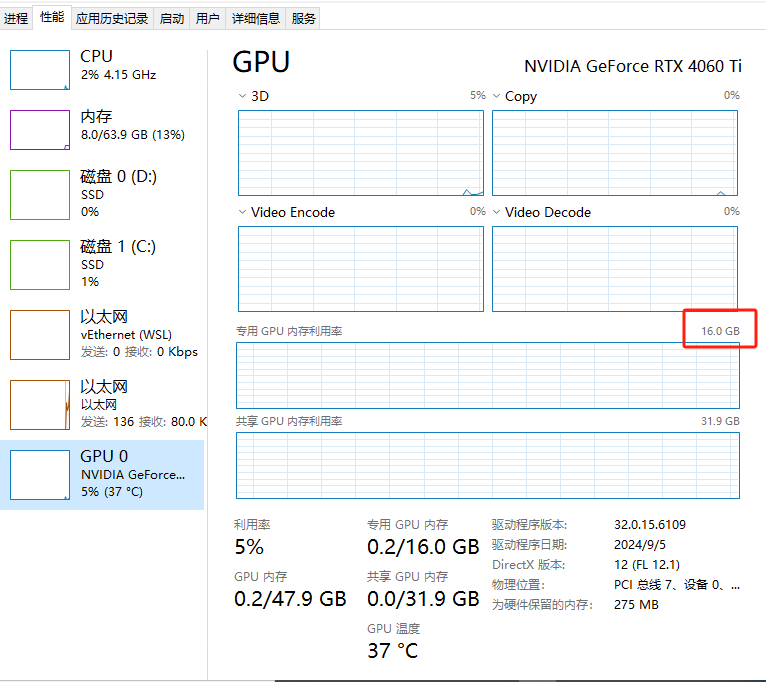

省吃俭用365天,终于高价(3600+)购入一张国产杂牌涩涩的RTX4060ti

旧卡拜拜,

拆开装上新卡

AI系统逻辑

硬件+软件+数据==推理问答

核心硬件

核心生产力工具就是显卡的算力+显存

其中GPU和应用软件之间需要: 驱动->Cuda开发包SDK-->Cudnn 深度神经网络SDK

核心软件

软件的核心就是 ollama

核心数据

各个大厂/小作坊的开源 模型数据

当然你有钱有闲也可以自己训练模型

搭建算力中心

下面以家用消费配件作单机算力来作个例子,一步步来搭建自己的完整的私有AI算力中心

操作系统要求: Linux/Debian ubuntu 或 Windows10专业版 22H2或更新

0.硬件配置价格

这次用消费市场的硬件来搭建:

| 设备名称 | 设备型号 | 核心参数 | 单价 | 数量 | 总价(人仔) |

|---|---|---|---|---|---|

| GPU显卡 | RTX 4060Ti | 16G 3072个CUDA | 3600.00 | 1 | 3600.00 |

| CPU | AMD 5800 | 8核16框 | 1000.00 | 1 | 1000.00 |

| 内存 | 64G DDR4 | 2条32G组成 | 500.00 | 2 | 1000.00 |

| 硬盘 | 2T | 2条1T SSD组成 | 500.00 | 2 | 1000.00 |

| 主板等 | 联想 | 刃7000p | 1200.00 | 1 | 1200.00 |

| 汇总 | 缅A赞助 | 必定精品 | 总价: | 7 | 7800.00(人仔) |

注:

GPU显存优先,最好16G以上,22G最佳,

CPU没讲究,4年内的R7/I7都可以,

内存32G以上,硬盘2个512G以上pcie-4x.说到底,男人还是不能太有钱,

1.安装GPU驱动

安装版本: 561.09 (202409)

https://www.nvidia.cn/geforce/drivers/

https://cn.download.nvidia.com/Windows/561.09/561.09-desktop-win10-win11-64bit-international-dch-whql.exe安装完毕后,(cmd)用下面命令查看是否安装成功

nvidia-smi

Wed Sep 25 10:06:32 2024

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 561.09 Driver Version: 561.09 CUDA Version: 12.6 |

|-----------------------------------------+------------------------+----------------------+

| GPU Name Driver-Model | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA GeForce RTX 4060 Ti WDDM | 00000000:07:00.0 Off | N/A |

| 0% 38C P8 11W / 165W | 127MiB / 16380MiB | 12% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

+-----------------------------------------------------------------------------------------+

| Processes: |

| GPU GI CI PID Type Process name GPU Memory |

| ID ID Usage |

|=========================================================================================|

| 0 N/A N/A 6188 C+G C:\Windows\explorer.exe N/A |

| 0 N/A N/A 7056 C+G ...5n1h2txyewy\ShellExperienceHost.exe N/A |

| 0 N/A N/A 7316 C+G ....Cortana_cw5n1h2txyewy\SearchUI.exe N/A |

| 0 N/A N/A 8112 C+G ....Experiences.TextInput.InputApp.exe N/A |

| 0 N/A N/A 8692 C+G ...crosoft\Edge\Application\msedge.exe N/A |

+-----------------------------------------------------------------------------------------+2.安装cuda toolkit

cuda toolkit你可以理解为 显卡算力接口的SDK开发包

根据上面显卡驱动信息(vidia-smi)的CUDA版本 (CUDA Version: 12.6),安装对应的CUDA

(20240925)安装版本: cuda_12.6.1_560.94_windows.exe

https://developer.nvidia.com/cuda-toolkit-archive/

cuda_12.6.1_560.94_windows.exe

装好后,看看编译器是否正常

> nvcc -V

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2024 NVIDIA Corporation

Built on Wed_Aug_14_10:26:51_Pacific_Daylight_Time_2024

Cuda compilation tools, release 12.6, V12.6.68

Build cuda_12.6.r12.6/compiler.34714021_03.安装cudnn SDK

Cudnn深度神经网络库,这个是AI的应用运算库,快速傅里叶变换的cuFFT、实现稀疏矩阵运算操作的cuSparse以及实现深度学习.

从官网下载对应的cuda版本

https://developer.nvidia.cn/rdp/cudnn-archive

- 下载cudnn

(20240925)安装版本: cudnn-windows-x86_64-8.9.7.29_cuda12-archive.zip

- 安装

解压cudnn-windows-x86_64-8.9.7.29_cuda12-archive.zip(bin等目录)到

C:Program FilesNVIDIA GPU Computing ToolkitCUDAv12.6cudnn (如无目录新建v12.6是cuda的版本,根据实际)

- 添加环境变量

我的电脑——>属性——>高级系统设置——>环境变量->PATH

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\bin

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\libnvvp

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\extras\CUPTI\lib64

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.6\cudnn\bin- 添加环境变量

4.安装 Docker Desktop

安装的版本是: Docker Desktop 4.34.2 (167172)

安装注意事项: 默认安装,特别注意需要勾选WSL

5.安装AI问答服务端

开源AI引擎+UI: ollama + open-webui

docker pull ollama/ollama

docker pull ghcr.io/open-webui/open-webui:main

docker run -d --gpus=all -e OLLAMA_NUM_PARALLEL=2 -e OLLAMA_MAX_LOADED_MODELS=2 -v ollama:/root/.ollama -p 11434:11434 --restart=always --name ollama ollama/ollama

docker run -d -p 6020:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main6.模型获取

7.模型训练

8.知识库

终端使用

本地打开 http://serverip:6020 ,第一个注册的用户是管理员,就可以离线使用类似ChatGPT功能的问答系统了.

实测效果

- 速度: 和搜索引擎差不多(比chat-gpt稳定+快速)

- 效率: 比搜索引擎高5倍以上

- 准确: 常规问题差不多,非常规问题百度优先.

搭建总结

Next:绘画

Debian安装

因为直接pve安装驱动失败,现在可以试试先安装 Debian12 到U盘,

然后装好显卡驱动,然后Debian12安装PVE